七月NLP课程笔记(1) NLP基础技能

七月NLP课程笔记(1) NLP基础技能

打算先听一下这套七月在线NLP的课程,涉及NLP一些常用的概念和方法,正好实验室研究的方向之一就是涉及NLP方面的。把这几次课的内容做笔记出来。

第一讲的主要内容是python中一些字符串处理的基本操作(包括正则表达式),然后主要讲了jieba中文工具。

# python字符串处理

比较字符串

cmp('strchr', 'strch')

# 结果为1

翻转字符串

str1 = 'abcd'

str2 = str1[::-1]

查找子串

str1.index('a')

str1.find('a')

# 区别在于index找不到会报错(注意了!),find找不到会返回-1

# 正则表达式

# 链接

可参照: https://app.codingcat.cn/docs/3_python_advanced/5_re/index.html

在线测试正则表达式的网站: https://regexr.com/

正则表达式在线练习: https://alf.nu/RegexGolf

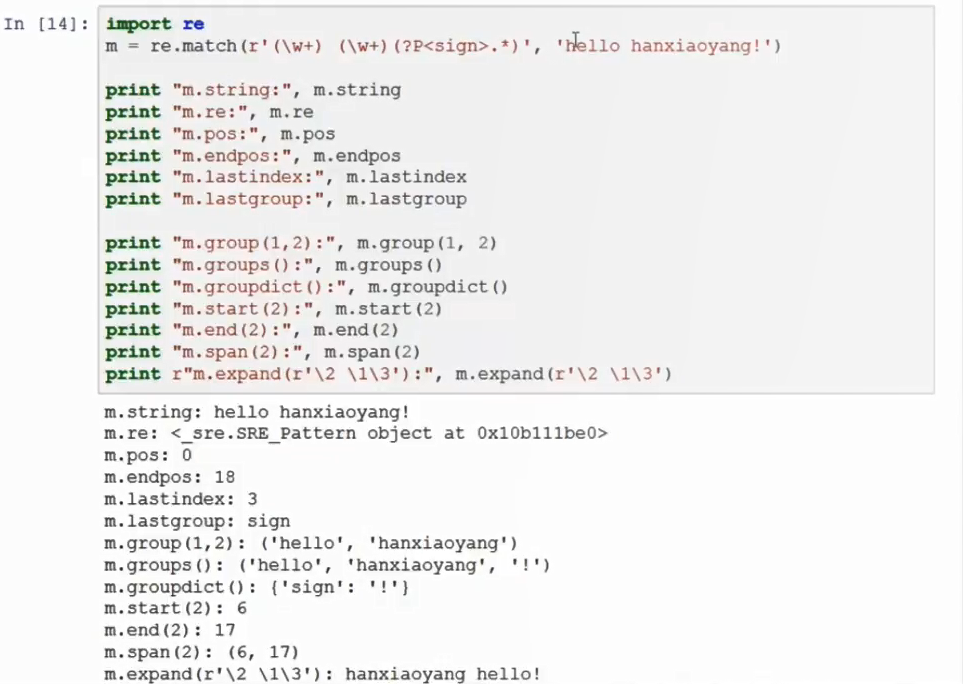

# re模块

使用python中的re模块做正则表达式:

预先编译pattern,使得更快:

预先编译pattern,使得更快:

pattern = re.compile(r'hello.*\!')

match = pattern.match('hello, hxg! How are you?')

if match:

print match.group()

# jieba中文处理

by 寒小阳

# 基本分词函数与用法

jieba.cut 以及 jieba.cut_for_search 返回的结构都是一个可迭代的 generator,可以使用 for 循环来获得分词后得到的每一个词语(unicode)

jieba.cut 方法接受三个输入参数:

需要分词的字符串

cut_all 参数用来控制是否采用全模式(得到所有可能的分词结果)

HMM 参数用来控制是否使用 HMM 模型

jieba.cut_for_search 方法接受两个参数

需要分词的字符串

是否使用 HMM 模型。

cut_for_search方法适合用于搜索引擎构建倒排索引的分词,粒度比较细

# encoding=utf-8

import jieba

seg_list = jieba.cut("我在学习自然语言处理", cut_all=True)

print seg_list

print("Full Mode: " + "/ ".join(seg_list)) # 全模式

seg_list = jieba.cut("我在学习自然语言处理", cut_all=False)

print("Default Mode: " + "/ ".join(seg_list)) # 精确模式

seg_list = jieba.cut("他毕业于上海交通大学,在百度深度学习研究院进行研究") # 默认是精确模式

print(", ".join(seg_list))

seg_list = jieba.cut_for_search("小明硕士毕业于中国科学院计算所,后在哈佛大学深造") # 搜索引擎模式

print(", ".join(seg_list))

2

3

4

5

6

7

8

9

10

11

12

13

14

15

输出:

Full Mode: 我/ 在/ 学习/ 自然/ 自然语言/ 语言/ 处理

Default Mode: 我/ 在/ 学习/ 自然语言/ 处理

他, 毕业, 于, 上海交通大学, ,, 在, 百度, 深度, 学习, 研究院, 进行, 研究

小明, 硕士, 毕业, 于, 中国, 科学, 学院, 科学院, 中国科学院, 计算, 计算所, ,, 后, 在, 哈佛, 大学, 哈佛大学, 深造

jieba.lcut以及jieba.lcut_for_search直接返回 list,其余功能与上面相同。

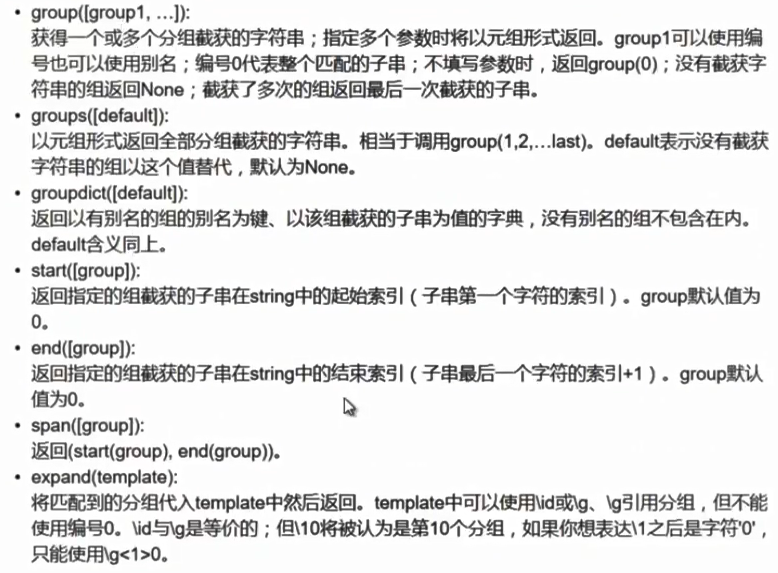

# 添加用户自定义词典

很多时候我们需要针对自己的场景进行分词,会有一些领域内的专有词汇。

1.可以用jieba.load_userdict(file_name)加载用户字典(每一行是一个词汇)

2.少量的词汇可以自己用下面方法手动添加: 用 add_word(word, freq=None, tag=None) 和 del_word(word) 在程序中动态修改词典

用 suggest_freq(segment, tune=True) 可调节单个词语的词频,使其能(或不能)被分出来。

# 关键词提取

# 基于 TF-IDF 算法的关键词抽取

import jieba.analyse

jieba.analyse.extract_tags(sentence, topK=20, withWeight=False, allowPOS=())

2

sentence 为待提取的文本 topK 为返回几个 TF/IDF 权重最大的关键词,默认值为 20 withWeight 为是否一并返回关键词权重值,默认值为 False allowPOS 仅包括指定词性的词,默认值为空,即不筛选

关于TF-IDF 算法的关键词抽取补充 关键词提取所使用逆向文件频率(IDF)文本语料库可以切换成自定义语料库的路径

用法: jieba.analyse.set_idf_path(file_name) # file_name为自定义语料库的路径

自定义语料库示例见这里https://github.com/fxsjy/jieba/blob/master/extra_dict/idf.txt.big

用法示例见这里https://github.com/fxsjy/jieba/blob/master/test/extract_tags_idfpath.py

关键词提取所使用停止词(Stop Words)文本语料库可以切换成自定义语料库的路径

用法: jieba.analyse.set_stop_words(file_name) # file_name为自定义语料库的路径

自定义语料库示例见这里https://github.com/fxsjy/jieba/blob/master/extra_dict/stop_words.txt

用法示例见这里https://github.com/fxsjy/jieba/blob/master/test/extract_tags_stop_words.py

关键词一并返回关键词权重值示例 用法示例见这里https://github.com/fxsjy/jieba/blob/master/test/extract_tags_with_weight.py

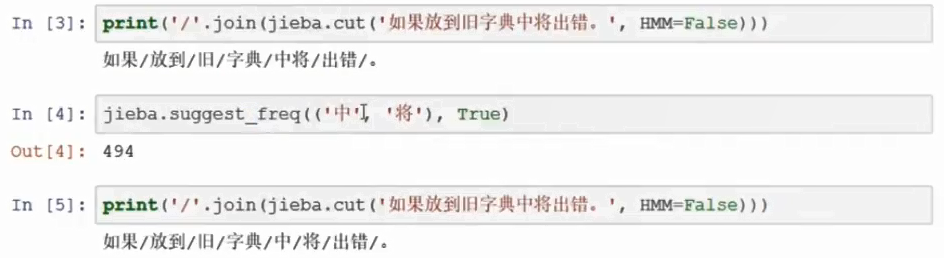

# 基于 TextRank 算法的关键词抽取

# 直接使用,接口相同,注意默认过滤词性。

jieba.analyse.textrank(sentence, topK=20, withWeight=False, allowPOS=('ns', 'n', 'vn', 'v'))

# 新建自定义 TextRank 实例

jieba.analyse.TextRank()

2

3

4

5

算法论文: TextRank: Bringing Order into Texts (http://web.eecs.umich.edu/~mihalcea/papers/mihalcea.emnlp04.pdf)

基本思想: 1)将待抽取关键词的文本进行分词 2)以固定窗口大小(默认为5,通过span属性调整),词之间的共现关系,构建图 3)计算图中节点的PageRank,注意是无向带权图

# 词性标注

jieba.posseg.POSTokenizer(tokenizer=None) #新建自定义分词器

# tokenizer 参数可指定内部使用的 jieba.Tokenizer 分词器

# jieba.posseg.dt 为默认词性标注分词器。

2

3

标注句子分词后每个词的词性,采用和 ictclas 兼容的标记法。 具体的词性对照表参见计算所汉语词性标记集(http://ictclas.nlpir.org/nlpir/html/readme.htm)

# 并行分词

原理:将目标文本按行分隔后,把各行文本分配到多个 Python 进程并行分词,然后归并结果,从而获得分词速度的可观提升 基于 python 自带的 multiprocessing 模块,目前暂不支持 Windows

用法:

jieba.enable_parallel(4) # 开启并行分词模式,参数为并行进程数 jieba.disable_parallel() # 关闭并行分词模式 实验结果:在 4 核 3.4GHz Linux 机器上,对金庸全集进行精确分词,获得了 1MB/s 的速度,是单进程版的 3.3 倍。

注意:并行分词仅支持默认分词器 jieba.dt 和 jieba.posseg.dt。

import sys

import time

import jieba

jieba.enable_parallel()

content = open(u'西游记.txt',"r").read()

t1 = time.time()

words = "/ ".join(jieba.cut(content))

t2 = time.time()

tm_cost = t2-t1

print('并行分词速度为 %s bytes/second' % (len(content)/tm_cost))

jieba.disable_parallel()

content = open(u'西游记.txt',"r").read()

t1 = time.time()

words = "/ ".join(jieba.cut(content))

t2 = time.time()

tm_cost = t2-t1

print('非并行分词速度为 %s bytes/second' % (len(content)/tm_cost))

并行分词速度为 830619.50933 bytes/second

非并行分词速度为 259941.448353 bytes/second

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

# 命令行使用jieba分词

使用示例:python -m jieba news.txt > cut_result.txt

命令行选项(翻译):

使用: python -m jieba [options] filename

固定参数: filename 输入文件 可选参数:

-h, --help 显示此帮助信息并退出

-d [DELIM], --delimiter [DELIM]

使用 DELIM 分隔词语,而不是用默认的' / '。

若不指定 DELIM,则使用一个空格分隔。

-p [DELIM], --pos [DELIM]

启用词性标注;如果指定 DELIM,词语和词性之间

用它分隔,否则用 _ 分隔

-D DICT, --dict DICT 使用 DICT 代替默认词典

-u USER_DICT, --user-dict USER_DICT

使用 USER_DICT 作为附加词典,与默认词典或自定义词典配合使用

-a, --cut-all 全模式分词(不支持词性标注)

-n, --no-hmm 不使用隐含马尔可夫模型

-q, --quiet 不输出载入信息到 STDERR

-V, --version 显示版本信息并退出

2

3

4

5

6

7

8

9

10

11

12

13

14

如果没有指定文件名,则使用标准输入。

# Tokenize

能够返回词语在原文的起止位置 注意,输入参数只接受 unicode

print "这是默认模式的tokenize"

result = jieba.tokenize(u'自然语言处理非常有用')

for tk in result:

print("%s\t\t start: %d \t\t end:%d" % (tk[0],tk[1],tk[2]))

print "\n-----------我是神奇的分割线------------\n"

print "这是搜索模式的tokenize"

result = jieba.tokenize(u'自然语言处理非常有用', mode='search')

for tk in result:

print("%s\t\t start: %d \t\t end:%d" % (tk[0],tk[1],tk[2]))

---

这是默认模式的tokenize

自然语言 start: 0 end:4

处理 start: 4 end:6

非常 start: 6 end:8

有用 start: 8 end:10

-----------我是神奇的分割线------------

这是搜索模式的tokenize

自然 start: 0 end:2

语言 start: 2 end:4

自然语言 start: 0 end:4

处理 start: 4 end:6

非常 start: 6 end:8

有用 start: 8 end:10

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

# jieba+whoosh中文搜索

关于whoosh中文搜索,之前整理过另一个文章,jieba+whoosh+haystack+django的搜索功能,看这里:https://segmentfault.com/a/1190000010866019

# -*- coding: UTF-8 -*-

from __future__ import unicode_literals

import sys,os

sys.path.append("../")

from whoosh.index import create_in,open_dir

from whoosh.fields import *

from whoosh.qparser import QueryParser

analyzer = jieba.analyse.ChineseAnalyzer()

schema = Schema(title=TEXT(stored=True), path=ID(stored=True), content=TEXT(stored=True, analyzer=analyzer))

if not os.path.exists("tmp"):

os.mkdir("tmp")

ix = create_in("tmp", schema) # for create new index

#ix = open_dir("tmp") # for read only

writer = ix.writer()

writer.add_document(

title="document1",

path="/a",

content="This is the first document we’ve added!"

)

writer.add_document(

title="document2",

path="/b",

content="The second one 你 中文测试中文 is even more interesting! 吃水果"

)

writer.add_document(

title="document3",

path="/c",

content="买水果然后来世博园。"

)

writer.add_document(

title="document4",

path="/c",

content="工信处女干事每月经过下属科室都要亲口交代24口交换机等技术性器件的安装工作"

)

writer.add_document(

title="document4",

path="/c",

content="咱俩交换一下吧。"

)

writer.commit()

searcher = ix.searcher()

parser = QueryParser("content", schema=ix.schema)

for keyword in ("水果世博园","你","first","中文","交换机","交换"):

print(keyword+"的结果为如下:")

q = parser.parse(keyword)

results = searcher.search(q)

for hit in results:

print(hit.highlights("content"))

print("\n--------------我是神奇的分割线--------------\n")

for t in analyzer("我的好朋友是李明;我爱北京天安门;IBM和Microsoft; I have a dream. this is intetesting and interested me a lot"):

print(t.text)

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

46

47

48

49

50

51

52

53

54

55

56

57

58

59

60

61

62

输出结果:

水果世博园的结果为如下:

买<b class="match term0">水果</b>然后来<b class="match term1">世博园</b>

--------------我是神奇的分割线--------------

你的结果为如下:

second one <b class="match term0">你</b> 中文测试中文 is even more interesting

--------------我是神奇的分割线--------------

first的结果为如下:

<b class="match term0">first</b> document we’ve added

--------------我是神奇的分割线--------------

中文的结果为如下:

second one 你 <b class="match term0">中文</b>测试<b class="match term0">中文</b> is even more interesting

--------------我是神奇的分割线--------------

交换机的结果为如下:

干事每月经过下属科室都要亲口交代24口<b class="match term0">交换机</b>等技术性器件的安装工作

--------------我是神奇的分割线--------------

交换的结果为如下:

咱俩<b class="match term0">交换</b>一下吧

干事每月经过下属科室都要亲口交代24口<b class="match term0">交换</b>机等技术性器件的安装工作

--------------我是神奇的分割线--------------

我

好

朋友

是

李明

我

爱

北京

天安

天安门

ibm

microsoft

dream

intetest

interest

me

lot

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

46

47

48

# 其他库

中文NLP方面较为权威的工具: https://github.com/NLPIR-team/NLPIR